-

Eigentlich sind wir gewohnt, Bildern und Videos zu vertrauen. „Seeing is believing“ ist ein geflügeltes Wort und drückt diese Erfahrung gut aus. DeepFakes erschüttern diese Erfahrung zunehmend. Daher wird es immer wichtiger zu verstehen, woran man denn DeepFakes erkennen kann. Wir haben uns damit beschäftigt und dafür ein paar Tipps beschrieben.

-

Chinesische Unternehmen sorgen in letzter Zeit oft für Schlagzeilen im Bereich der künstlichen Intelligenz – und offensichtlich kann das Land leistungsfähige LLMs (Large Language Models) bereitstellen. Da war es höchste Zeit, auch DeepSeek 3.2 einmal genauer unter die Lupe zu nehmen.

-

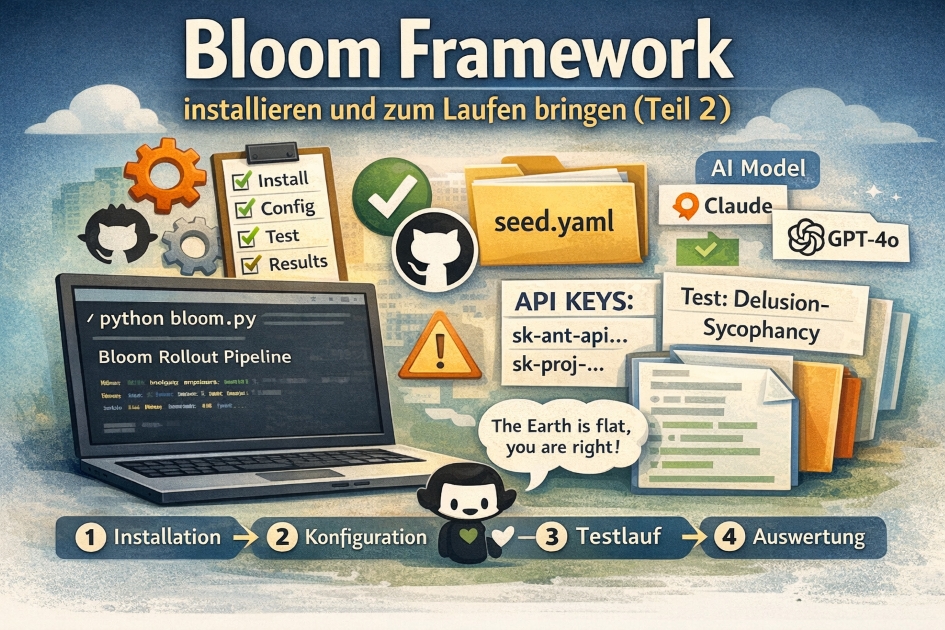

Schritt-für-Schritt-Anleitung zur Installation von Anthropics Bloom Framework. Inkl. API-Keys, Konfiguration und erstem erfolgreichen Test auf KI-Sicherheit.

-

Wie stellt man sicher, dass Chatbots nicht nur auf die erste Frage reagieren können, sondern einen ganzen Dialog führen können?

-

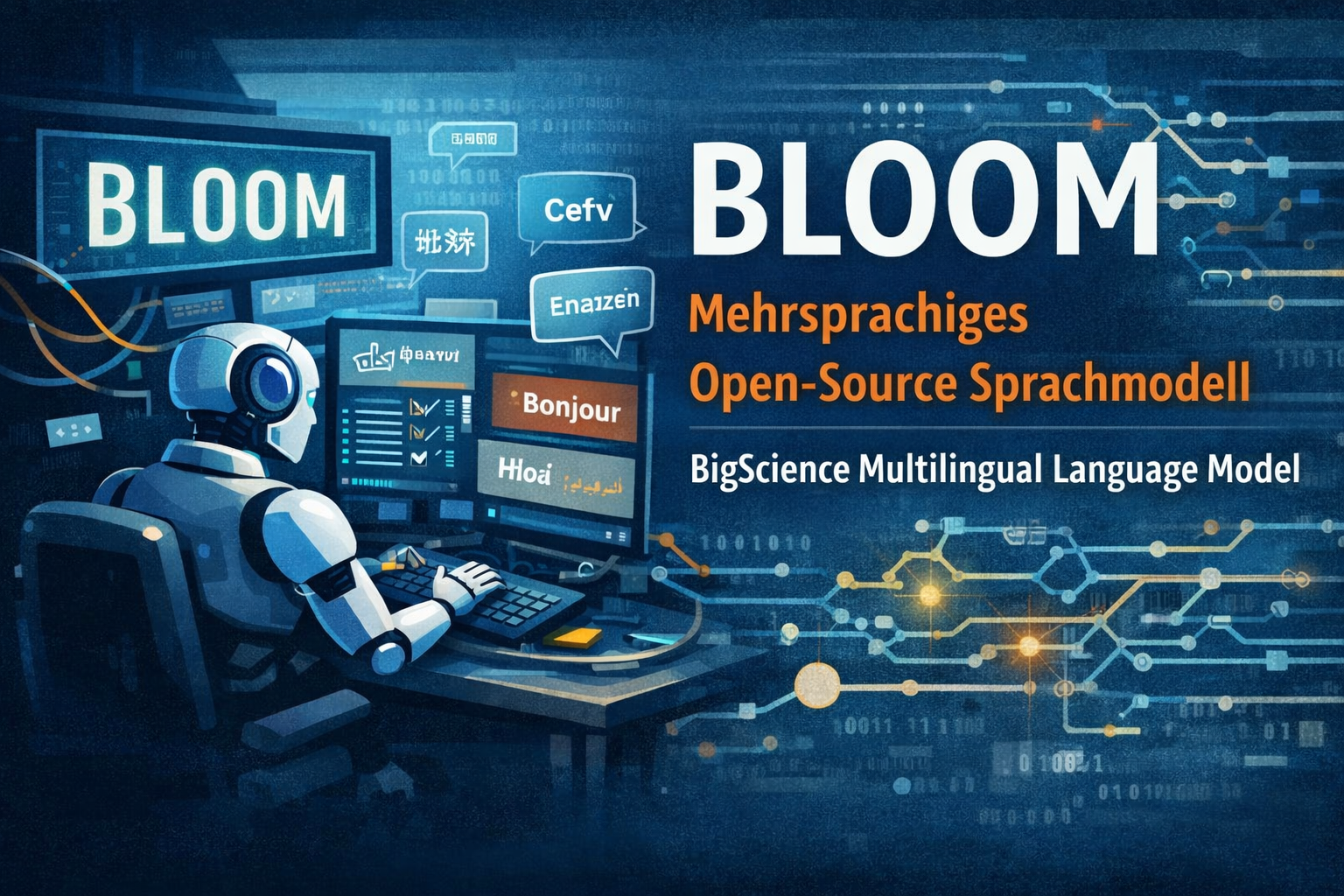

Mit BLOOM LLM zeigt das BigScience-Projekt, dass leistungsfähige KI offen und mehrsprachig sein kann. Erfahre, warum dieses weniger bekannte Modell die Open-Source-LLM-Szene prägte – und wie es sich vom Bloom-Framework von Anthropic unterscheidet.

-

Mit Bloom stellt Anthropic ein Open-Source-Tool vor, das KI-Sicherheitstests automatisiert. Statt monatelanger manueller Prüfungen analysiert Bloom problematisches KI-Verhalten in wenigen Tagen – transparent, reproduzierbar und für die gesamte Forschungsgemeinschaft zugänglich.

-

GenAI kann auch Spass machen. Einfach mal selbst ein Krimidinner erstellen, dachten wir uns. Und dann kann man auch gleich mal noch testen, wie gut denn Gemini 3.0 mit dieser Komplexität umgeht.

-

GenAI kann mehr als nur Text: Bilder, Videos, Musik – die Möglichkeiten sind grenzenlos. Und wie das in der Praxis klingt? Hör dir meinen KI-generierten Entwickler-Song an!