-

Die richtige Frage bekommt eher die richtige Antwort als die falsche – was wie eine Binsenweisheit klingt kann bei Wissensdatenbanken echt ein Thema werden. Wir schauen uns in dem Beitrag näher an, wie man für die richtige Frage sorgen kann.

-

In einem Paper für die ICLR 2026 haben einige Wissenschaftler eine bemerkenswerte Interpretation des Themas „Halluzinationen“ vorgestellt. Das fanden wir so spannend und nützlich, dass wir das in einem etwas verständlicheren Artikel nochmal beschreiben und erklären wollten.

-

GPT 5.4 ist ein wichtiger Schritt für AI – und wir interessieren uns für die Verlässlichkeit von AI im Service. Daher mussten wir einfach mal testen, was GPT 5.4 da bietet.

-

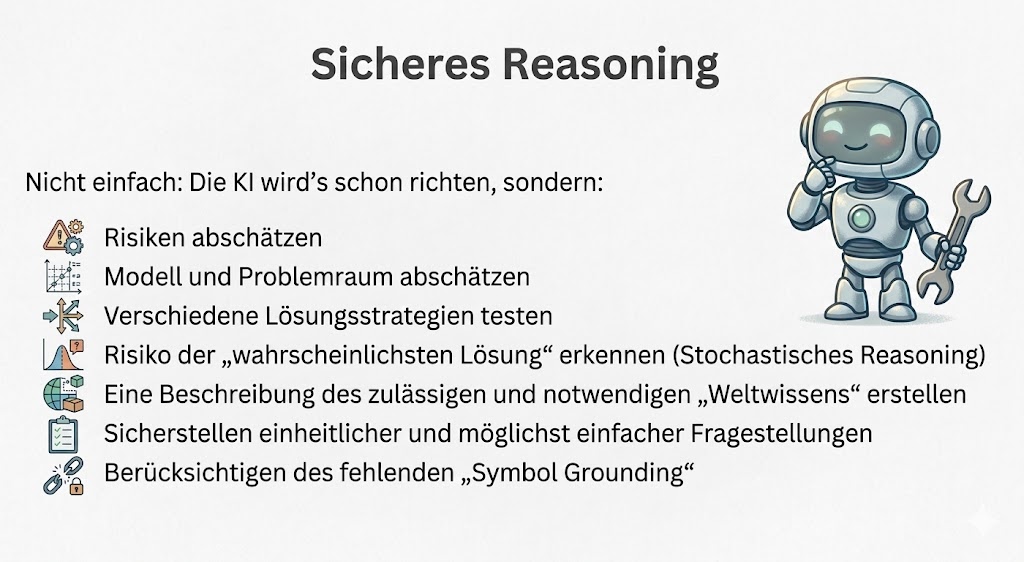

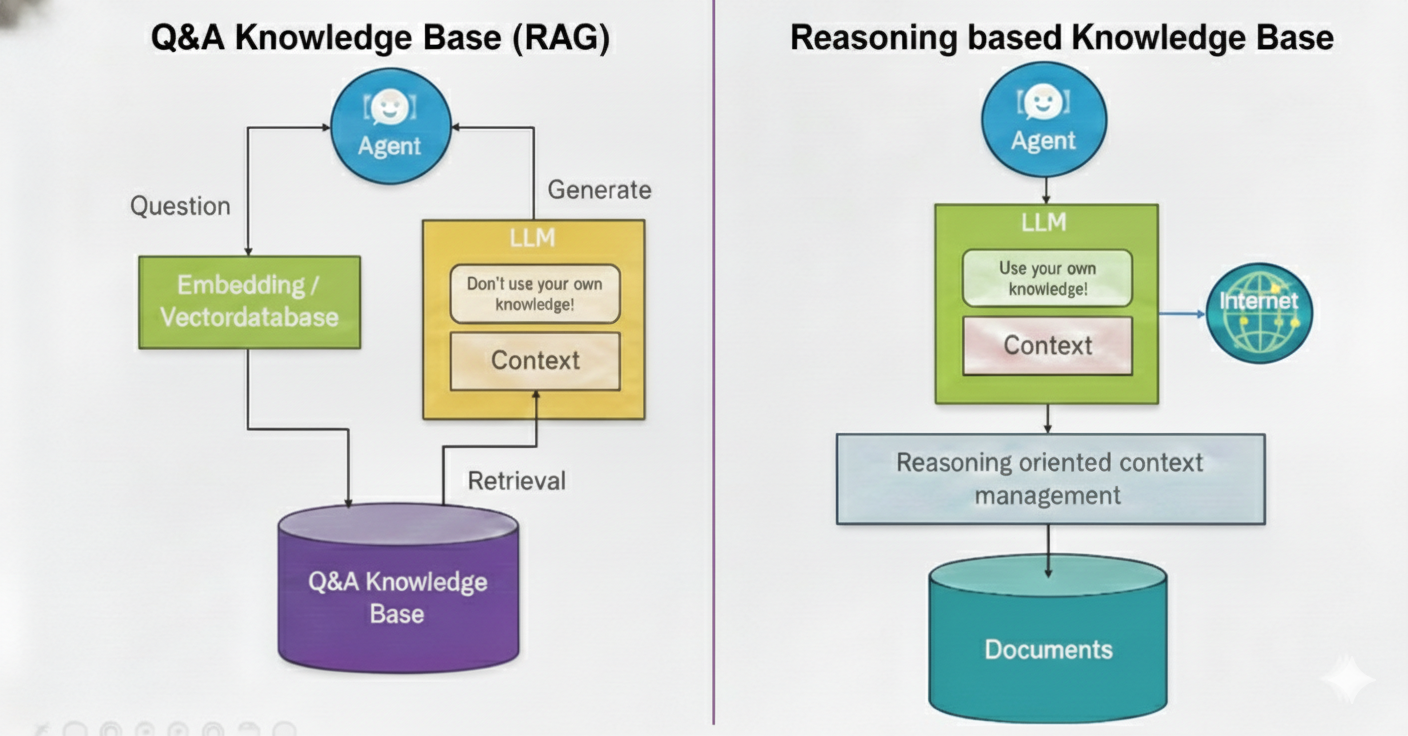

Mit Reasoning ist es möglich, dass ein System nicht nur Texte wiederholt, sondern selbstständig Antworten aus einem Wissensbestand ableitet, und damit den Redaktionsbedarf drastisch reduziert. Wer Reasoning produktiv einsetzen möchte, muss verstehen, wie es funktioniert und wo seine Grenzen liegen. Dieser Beitrag gibt dazu praxisnahe Orientierung.

-

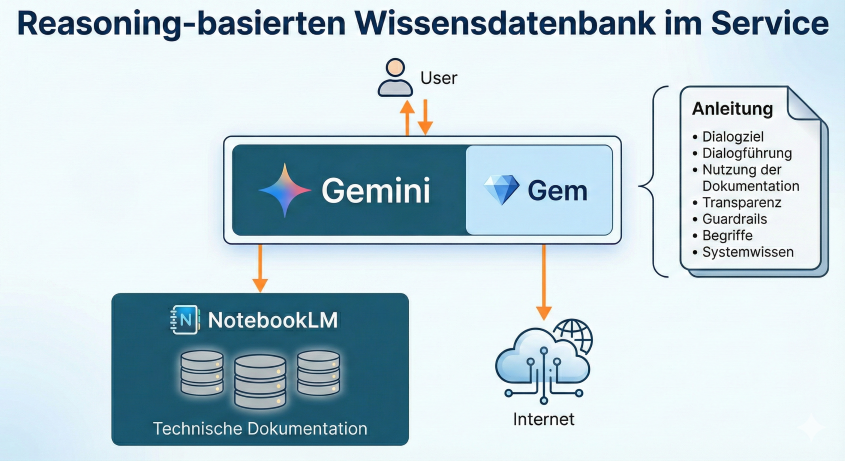

Wie geht man vor, wenn man sich einen MVP für eine Reasoning-basierte Wissensdatenbank erstellen will? Wir haben mal einen kleinen Blueprint geschrieben.

-

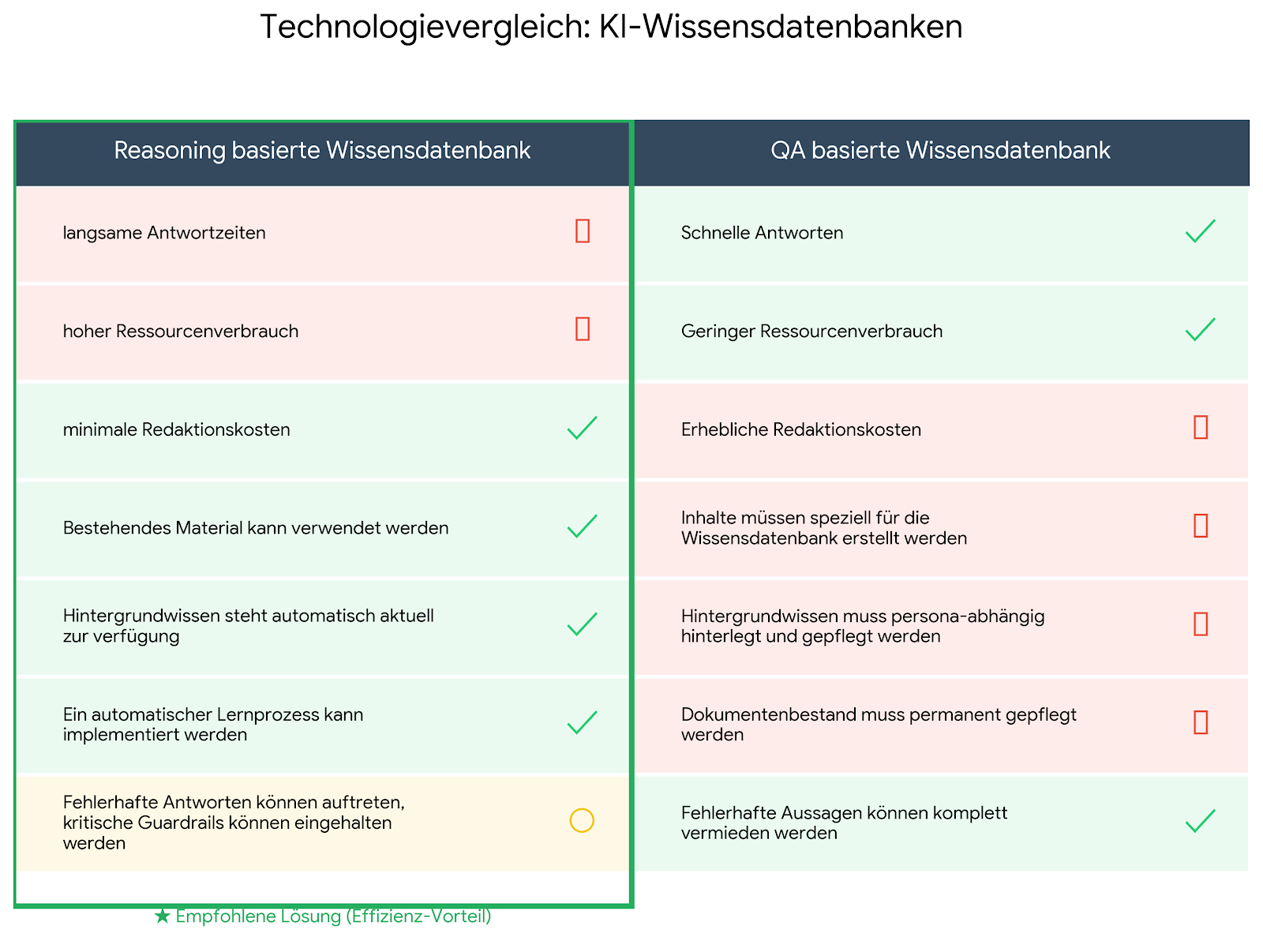

Wissensdatenbanken als Assistenten im technischen Service werden heute oft noch wenig eingesetzt, weil der Pflegeaufwand ziemlich hoch ist. Setzt man auf ein Reasoning-basiertes Konzept, reduziert sich der Aufwand für die Erstellung und Pflege des Wissens um 90% oder 95%. Allerdings können auch fehlerhafte Antworten auftreten. Wir haben mal die Vorteile und Nachteile zusammengestellt.

-

Seit Anthropic seine Legal Plug-Ins vorgestellt hat ist die Idee im Markt: Rechtliche Fragen klärt man per AI. Geht das wirklich? Und was kann man daraus lernen?

-

Der Redaktionsaufwand für Wissensdatenbanken ist im technischen Bereich oft exorbitant hoch und gerade von mittleren und kleineren Organisationen nicht leistbar. Reasoning-basierte GenAI Wissensdatenbanken werden hier immer mehr zu einer extrem attraktiven Alternative.

-

Lösungen und Antworten per Reasoning generieren ist viel effizienter, als alle Antworten vorsehen und dann nur Antworten zitieren. Aber da muss man auch wissen wie. Ein paar Tipps können wir geben. Und da wir einen sehr spannenden Artikel mit einer ähnlichen Aussage gefunden haben, dachten wir schreiben das mal auf.

-

DeepSeek ist in den letzten Wochen mit sehr tiefgehenden Innovationen aufgefallen. Sowohl mHC (magnifold-Constrained Hyper-Connections) als auch Engram sind Innovationen, die sich direkt mit dem Kern der Architektur des Deep Learnings beschäftigen und die das Lerntempo und die notwendigen Ressourcen optimieren. Und so haben wir uns mal das Reasoning ein bisschen näher angesehen.