Eigentlich sind wir gewohnt, Bildern und Videos zu vertrauen. „Seeing is believing“ ist ein geflügeltes Wort und drückt diese Erfahrung gut aus. DeepFakes erschüttern diese Erfahrung zunehmend. Daher wird es immer wichtiger zu verstehen, woran man denn DeepFakes erkennen kann. Wir haben uns damit beschäftigt und dafür ein paar Tipps beschrieben.

Vertrauen – die wichtigste Währung einer Gesellschaft

Eigentlich ist es fast witzig. Da entlaufen einige kleine Affen in St. Louis (USA). Beim Versuch, die Tiere wieder zu fangen sind die Behörden auf die Mithilfe der Bürger angewiesen, die ihnen über Sichtungen der Tiere berichten. Allerdings wird die Arbeit der Behörden durch DeepFakes erschwert, mit denen Bürger über Sichtungen berichten, die natürlich nicht wahr sind (Multiple monkeys on the loose in St. Louis | AP News).

Wenn in dem Video die Äffchen ein Auto entführen und damit davonbrausen, dann ist das ja noch witzig und einfach erkennbar (https://youtu.be/8olFFWRqJBo?si=lxptBMYtiX5ntGGo). In anderen Fällen jedoch sind die Behörden erst einmal irritiert und fahren im schlimmsten Fall an den falschen Ort. Und die Äffchen genießen noch einige Tage mehr ihre Freiheit.

In anderen Fällen hinterlässt ein DeepFake verunsicherte Bürger. Wenn ein Video von Yanis Varoufakis (ehemaliger griechischer Finanzminister) ein hochgeheimes Treffen der westlichen Finanzminister mit brisantem Inhalt beschreibt, dann kann das bis zur Panik führen (YouTube, dieses Video wurde von Youtube entfernt bzw. der Kanal wurde gekündigt).

Oder wenn im russischen Fernsehen Beiträge von CBCN gezeigt werden (siehe Artikel in Newsguard), in denen fälschlicherweise behauptet wird, dass die ukrainischen Athleten aufgrund ihres aggressiven Verhaltens möglichst weit weg vom olympischen Dorf untergebracht werden, dann dient das nur dem Ziel, Hass und Abstand zu sähen.

Es wird für uns alle wichtig werden, DeepFakes zu erkennen. Und eigentlich ist das immer noch möglich. Man braucht eben ein bisschen Kopf dazu…

Selbst denken ist immer noch ein guter Ansatz

Wenn auf Facebook behauptet wird, Messi wäre mit seiner Frau in Nigeria gewesen (https://dubawa.org/viral-photo-of-messi-wife-visiting-nigeria-is-ai-generated), dann kann man immer selbst prüfen, wo denn Messi zu dieser Zeit gewesen ist. Immerhin hat Messi einen Instagram-Account. Und man kann schauen, wo er gespielt bzw. trainiert hat. Und auch wenn Pabst Leo XIV eine Weltuntergangsrede hält kann man auf seinen originalen Kommunikationskanälen schauen (https://katholisch.de/artikel/62258-ki-gefaelschte-predigten-von-papst-leo-xiv-fluten-das-internet) und kann sehr einfach feststellen, ob das nun echt ist oder nicht. Und ob nun Yanis Varoufakis als ehemaliger Finanzminister tatsächlich an einem hochgeheimen Treffen der aktuellen Finanzwelt teilnehmen würde kann man ja auch mal hinterfragen.

Die ukrainischen Athleten nutzen auch Social Media und man sieht, wo sie sich im olympischen Dorf aufhalten. Und generell gibt es genügend andere Berichte über Olympia, an denen man sich orientieren kann.

Es gibt aber auch einiges an Tipps, Organisationen und technischen Hilfen, die einen wirklich weiterbringen. Beispiele für internationale Organisationen findet man auf https://ifcncodeofprinciples.poynter.org/signatories.

Genau hinschauen

Trotz aller Perfektion sind DeepFakes zum Glück oft noch erkennbar.

Oft einfach an ihrer Perfektion – alles ist aufgeräumt, schick und schön. Allerdings kann man diese Perfektion beim Bildgenerieren durch intelligentes Prompting auch vermeiden. Dann sehen die Bilder oft wie echte Alltagsschnappschüsse aus.

Zum Glück ist im Moment zumindest die Bildgenerierung immer noch so, dass man in diesen generierten Bildern Fehler findet.

Da die Modelle eher ein statistisches Wissen über die Welt und die zu generierenden Bilder haben statt einem faktischen und physikalischen, generieren die Modelle die immer gleichen Fehler. Fingerhaltungen sind gerne etwas unnatürlich, die Haut von Personen zu perfekt, um wahr zu sein. Reflexe in den beiden Augen sind oft unterschiedlich, anders als in der Realität. Übergänge sind häufiger unscharf, beispielsweise zwischen dem hellen haltenden Finger und dem schwarzen Handy oder in komplexen Mustern z.B. auf Kleidern.

Gerade bei Videos verschmelzen in kurzen Phasen gerne verschiedene Objekte, beispielsweise in dem oben erwähnten Film mit den Affen die Arme der Äffchen mit dem Auto oder sie greifen durch die Windschutzscheibe.

Gerade in schnell bewegten Videos entstehen auch immer noch plötzlich auftauchende und wieder verschwindende Artefakte wie helle oder dunkle, verwaschene Flecken, die nichts mit der „Physik“ der Bilder zu tun haben.

Mit den neuen Versionen von Kling oder Seedance ist es noch schwieriger geworden. Diese Tools generieren weniger Fehler und können sogar teilweise mit realen Bildern von Räumen gefüttert werden, um realistische Videos zu produzieren.

Hier muss man oft auf Hintergründe und die dargestellten Räume achten. Denn genau damit hat GenAI ziemlich viele Probleme – im Moment. Wenn der Protagonist aufsteht und die Tür ist im Moment links, die Kamera schwenkt, der Protagonist läuft los und die Tür ist rechts, dann kann man mit genauem Hinschauen erkennen, dass das eben ein Fake ist.

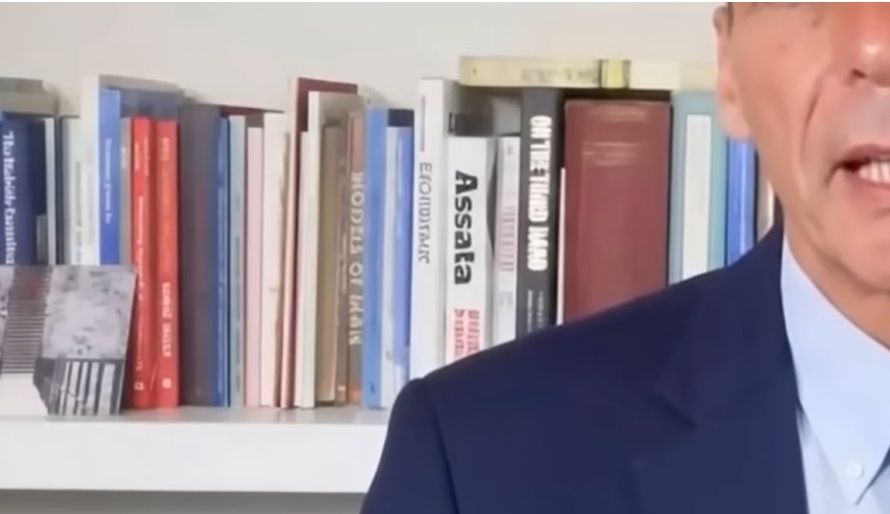

Am Besten erkennt man DeepFakes, wenn reale Objekte wie Handys, Markenartikel oder Bücher enthalten sind. In dem Video von Yanis Varoufakis sieht man ihn vor einem Bücherregal. Versucht man, die Titel der Bücher auf den Bücherrücken zu lesen bemerkt man, dass das alles nichtssagende Ketten von irgendwelchen buchstabenähnlichen Zeichen sind. Aber keine Texte. Genauso ist das bei verpackten Markenprodukten wie Flaschen oder Dosen. Zudem werden oft nicht existente Produktvarianten wie nicht existente Marken oder nicht existente Handys generiert.

Genau hinschauen lohnt sich also, wenn man sich informieren möchte.

Der einfachste Weg: GenAI prüft GenAI

Man kann jedoch auch technische Hilfe nutzen – zum Beispiel GenAI wie ChatGPT, Claude oder Gemini. Man verweist auf das Video oder lädt Bild oder Video hoch und fragt nach.

Das spannende ist, dass die künstliche Intelligenz dann nicht nur die Bilder auf ihre Wahrheit und potenzielle Bildfehler abprüft, sondern auch noch die Inhalte auf ihre Logik checkt: Existiert das im Bild dargestellte Handy wirklich? Macht es Sinn, dass Affen ein Auto steuern? Wird auf anderen Quellen über das beschriebene Ereignis berichtet.

Besonders gut schlägt sich hier Gemini. Hier kommt dazu, dass Google mit SynthID eine Art Wasserzeichen generiert. Verwendet man also GenAI von Google, um Bilder zu produzieren wie das erfolgreiche Banana Pro ist es immer möglich, diese zu erkennen. Google betont immer wieder, dass es ihnen wichtig ist, dass generierte Bilder erkennbar sind. Das ist leider bei anderen Anbietern nicht der Fall.

Auch eine gute Wahl ist Hive (https://thehive.ai/). In unseren Tests konnte Hive in allen Fällen GenAI erkennen, auch dann, wenn Gemini noch unsicher war.

Allerdings ist der große Vorteil von Gemini, dass es seine Bewertung begründet und den Inhalt und Kontext bewertet, nicht nur das Bild als solches. Bei Hive erhält man nur ein Ergebnis, das damit etwas schwierig zu interpretieren ist.

Rückwärtssuche enttarnt Fälschungen

Gerne werden auch echte Bilder oder Videos manipuliert, um beispielsweise Zusammentreffen zwischen Epstein und anderen bekannten Persönlichkeiten zu behaupten. Hier lohnt sich eine Rückwärtssuche. Tatsächlich sind hier GenAI Tools wie OpenAI oder Gemini „verheerend“ schlecht. Weder GPT noch Gemini liefern hier irgendwelche verwendbare Ergebnisse.

Aber die gute alte Google Bildersuche hilft hier weiter.

Das ist auch bei Videos so. Im Fall der russischen Fakenews zum angeblich aggressiven ukrainischen Team ist es recht schwierig, den Fake zu erkennen. Man hat Stimmen doch nicht so gut im Gehör und ist vielleicht auch auf dem akustischen Kanal nicht so aufmerksam, dass man eine über einen Film gelegte gefälschte Tonspur erkennt. Und kennt man den Originalfilm nicht, fallen reingeschnittene Aufnahmen nicht sonderlich auf.

Eine Rückwärtssuche in Google mit einem Screenshot des Films hilft in Sekunden, die Fälschung zu entlarven.

Und es wird nicht einfacher

Im Februar 2026 hat Qwen sein neues Image 2.0 veröffentlicht. Es wurde viel Wert auf präzise Textdarstellung gelegt – und schon wird das Erkennen von Fakes etwas schwieriger.

Ein wie ich finde schönes Beispiel wurde auch gezeigt:

Hier wurde Image-2.0 dafür verwendet, zwei einzeln aufgenommene Personen gemeinsam darzustellen. Das macht Bildfälschungen noch viel einfacher.

Und man sieht es kaum: Beispielsweise entlarvt ein genauer Blick auf den gemusterten Kragen in den beiden Bildern die Fälschung – wenn man das Original hat. Ansonsten erkennt man es kaum.

Es wird also nicht einfacher werden, Fälschungen zu erkennen.

Fazit

Es wird für uns alle, für unsere Gesellschaft und unsere Demokratie immer wichtiger, die Verlässlichkeit von Informationen zu prüfen. Das trifft besonders bei unserem informativsten und in der Vergangenheit auch verlässlichsten Kanal, dem Sehen zu.

Daher ist es wichtig die Fähigkeit zu entwickeln, diese DeepFakes erkennen zu können. Und mit ein bisschen Übung und Technologieunterstützung geht das auch noch. Zum Glück!

Übersicht von Organisationen, die bei der Aufklärung von Fake News unterstützen

https://www.newsguardrealitycheck.com

https://www.br.de/nachrichten/faktenfuchs-faktencheck,QzSIzl3

Schreibe einen Kommentar